Как Internet Archive решает, что архивировать: приоритеты, частота, источники данных

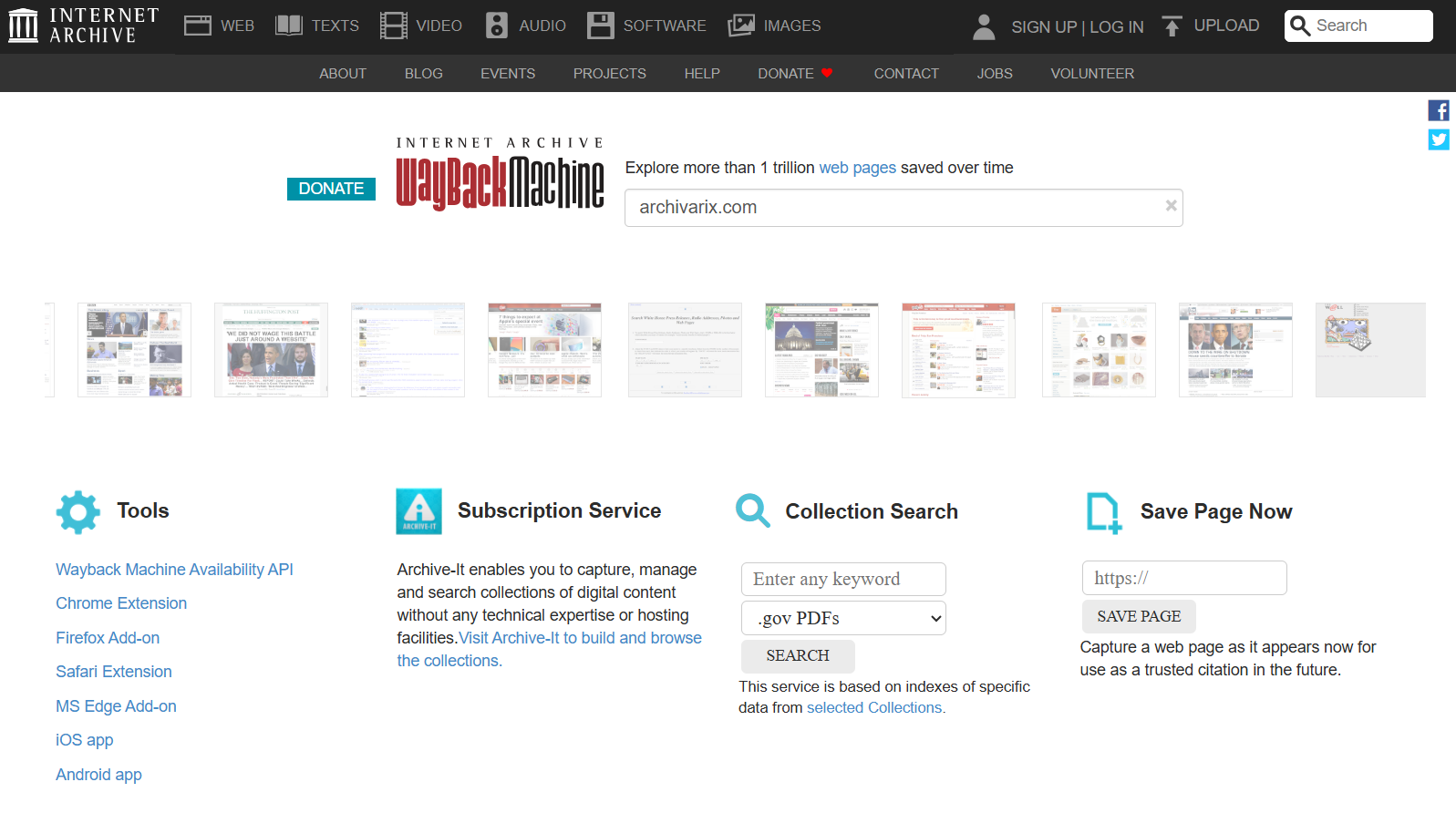

Триллион сохранённых страниц. Более 99 петабайт данных. Сотни краулов, работающих каждый день одновременно. За этими цифрами стоит вопрос, который задаёт себе каждый, кто профессионально работает с веб-архивами: как именно Wayback Machine решает, какие сайты сканировать, как часто возвращаться к ним, и почему одни домены представлены в архиве тысячами снэпшотов, а другие имеют всего несколько записей за десять лет?

Понимание этих механизмов критически важно для всех, кто занимается восстановлением сайтов. Если вы знаете, как работает система изнутри, вы можете предсказать, что найдёте в архиве, а чего там не будет. И можете повлиять на архивирование собственных сайтов, пока они ещё живы.

Читать дальше…

Понимание этих механизмов критически важно для всех, кто занимается восстановлением сайтов. Если вы знаете, как работает система изнутри, вы можете предсказать, что найдёте в архиве, а чего там не будет. И можете повлиять на архивирование собственных сайтов, пока они ещё живы.

Веб Архив в 2026 году: что изменилось и как это влияет на восстановление сайтов

В октябре 2025 года Wayback Machine достиг отметки в один триллион сохранённых веб-страниц. Более 100 000 терабайт данных. Это огромное достижение для некоммерческой организации, которая работает с 1996 года. Но за этой красивой цифрой скрывается непростой период, через который прошёл Internet Archive за последние полтора года. Кибератаки, судебные иски, изменения в политике доступа и новые вызовы от AI-компаний - всё это напрямую влияет на тех, кто использует веб-архив для восстановления сайтов.

Читать дальше…

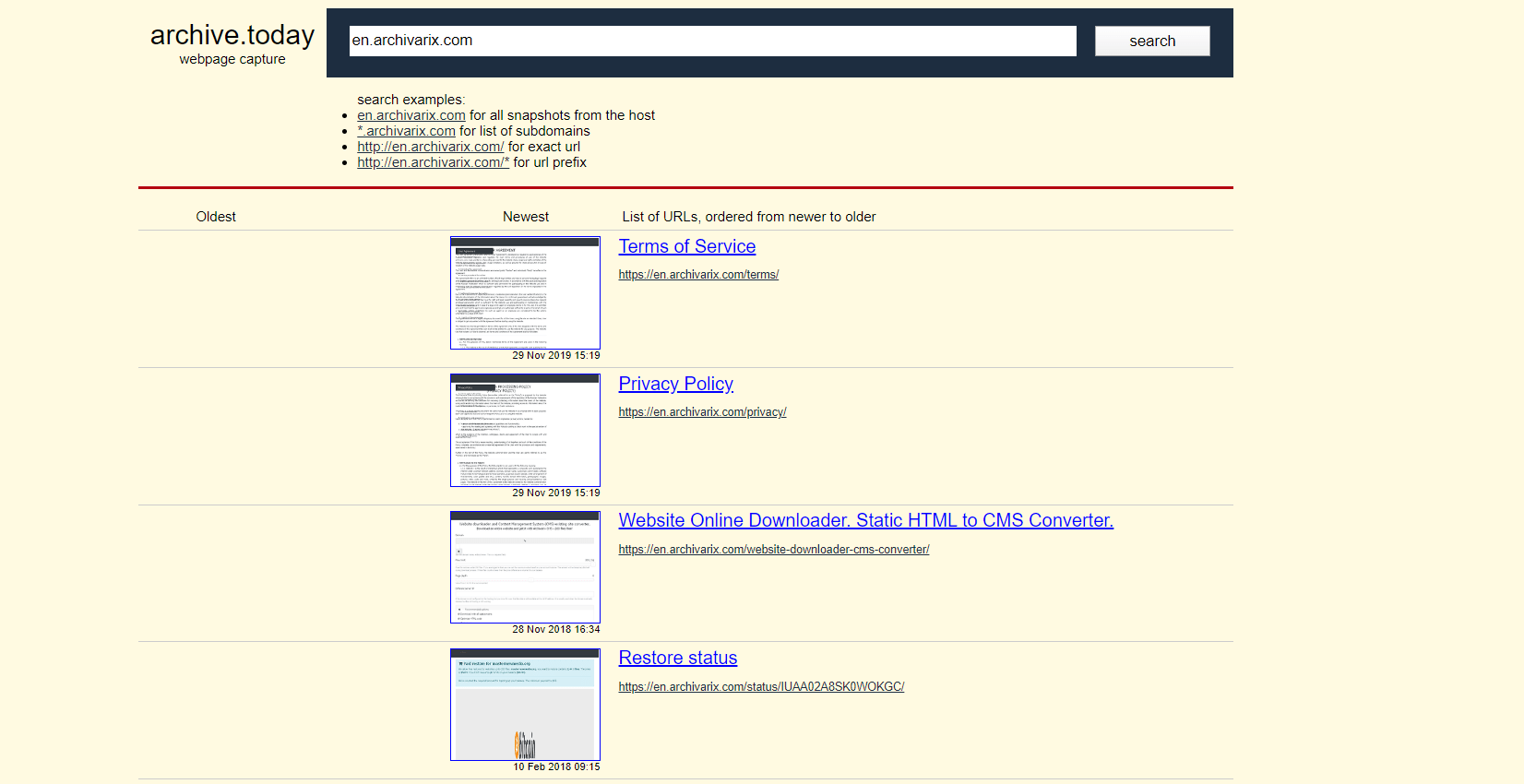

Аналоги web.archive.org. Как найти удаленные сайты?

Веб Архив ( Archive.org) - самый известный и самый большой архив сайтов в мире. На их серверах сейчас находится более 400 миллиардов страниц. Существуют ли какие-либо системы, аналогичные Archive.org?

Читать дальше…