Онлайн сервис восстановления сайтов из Веб Архива.

Восстановите полностью работоспособную копию сайта!

Если вы не знаете на каком сайте из веб архива проверить нашу систему - скачайте тестовое восстановление.

Чтобы посмотреть восстановление локально без использования хостинга, рекомендуем установить XAMPP сервер на ваш компьютер. Во время установки вам достаточно выбрать только Apache и PHP.

Чтобы посмотреть восстановление локально без использования хостинга, рекомендуем установить XAMPP сервер на ваш компьютер. Во время установки вам достаточно выбрать только Apache и PHP.

Цены восстановления

Сайт содержит

до 200 файлов

- Сайты, которые содержат до 200 файлов, стоят всего $0.25.

Сайт содержит

201-1200 файлов

- Большинство сайтов, которые восстанавливают наши пользователи, содержат до 1000 файлов и стоят менее $4.

Сайт содержит

более 1200 файлов

- Если нужный вам сайт содержит более 1200 файлов, то каждая последующая тысяча файлов будет стоить всего один доллар.

Онлайн сервис скачивания сайтов и конвертации на CMS.

Скачайте полностью работоспособную копию сайта!

Возможность скачивать .onion сайты!

Если вы не знаете на каком сайте из веб архива проверить нашу систему - скачайте тестовое восстановление.

Чтобы посмотреть восстановление локально без использования хостинга, рекомендуем установить XAMPP сервер на ваш компьютер. Во время установки вам достаточно выбрать только Apache и PHP.

Чтобы посмотреть восстановление локально без использования хостинга, рекомендуем установить XAMPP сервер на ваш компьютер. Во время установки вам достаточно выбрать только Apache и PHP.

Цены скачивания

Сайт содержит

до 200 файлов

- Сайты, которые содержат до 200 файлов, стоят всего $0.25.

Сайт содержит

201-1200 файлов

- Большинство сайтов, которые скачивают наши пользователи, содержат до 1000 файлов и стоят менее $4.

Сайт содержит

более 1200 файлов

- Если нужный вам сайт содержит более 1200 файлов, то каждая последующая тысяча файлов будет стоить всего один доллар.

Последние статьи из блога:

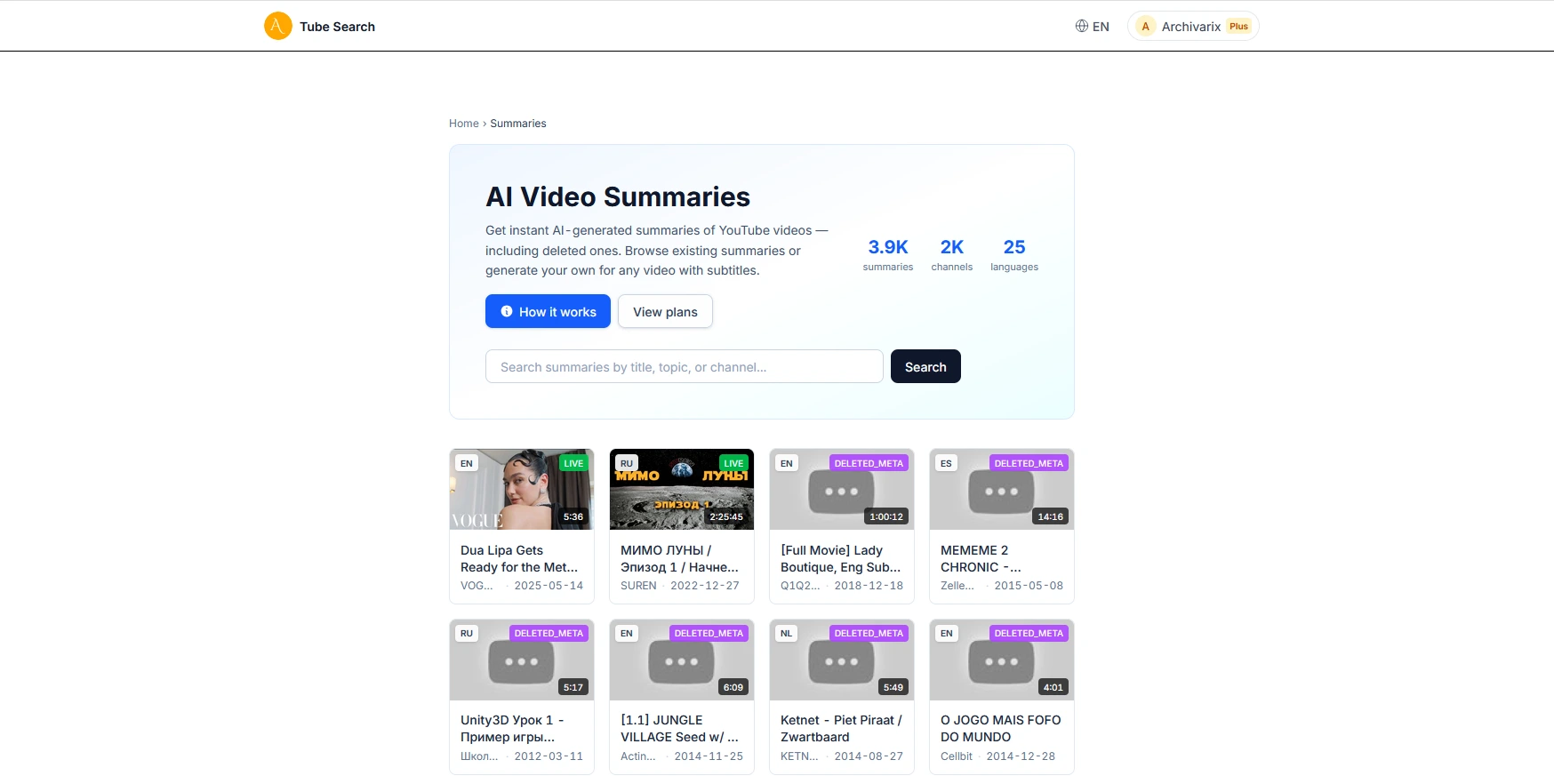

AI-саммари видео в Archivarix Tube Search

Когда вы находите удалённое видео YouTube через Tube Search, вы обычно получаете метаданные: название, описание, дату загрузки и иногда субтитры. Это уже полезно. Но чтение необработанных субтитров, чтобы понять, о чём было видео, требует времени, особенно для длинных записей.

Мы добавили в Tube Search AI-саммари видео. Если у видео есть архивные субтитры, система может за считанные секунды сгенерировать структурированное изложение его содержания.

Читать дальше…

Мы добавили в Tube Search AI-саммари видео. Если у видео есть архивные субтитры, система может за считанные секунды сгенерировать структурированное изложение его содержания.

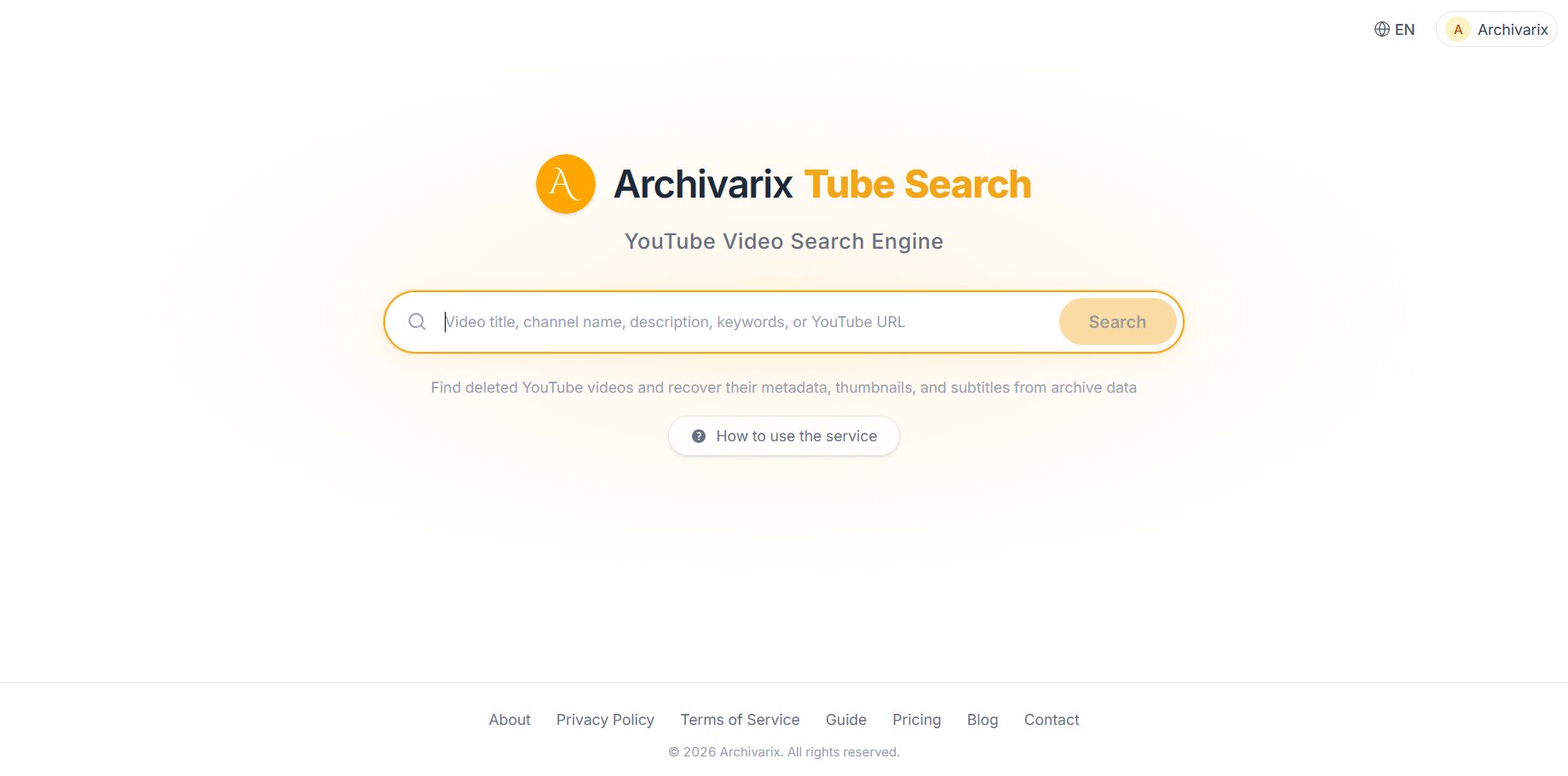

Archivarix Tube Search - Поисковая система по удаленным видео YouTube

Tube Search - это поисковый движок по архивным данным YouTube. Сервис агрегирует информацию из нескольких публичных источников: Wayback Machine (Internet Archive), Common Crawl и различных собранных датасетов метаданных YouTube. Когда видео удаляется с YouTube, его страница перестает существовать. Но если до удаления эту страницу успел проиндексировать один из веб-архивов, метаданные видео сохраняются: название, описание, дата загрузки, количество просмотров, превью-изображения, субтитры.

Читать дальше…

Archivarix Broken Links Recovery: бесплатный плагин WordPress для поиска и восстановления битых ссылок

Со временем внешние ссылки в записях Wordpress неизбежно ломаются, страницы удаляются, домены истекают, видео становятся недоступными. Проверять сотни или тысячи ссылок вручную непрактично. Archivarix Broken Links Recovery автоматизирует этот процесс: плагин сканирует контент, находит битые ссылки и заменяет их рабочими копиями из Wayback Machine.

Читать дальше…

Как Internet Archive решает, что архивировать: приоритеты, частота, источники данных

Триллион сохранённых страниц. Более 99 петабайт данных. Сотни краулов, работающих каждый день одновременно. За этими цифрами стоит вопрос, который задаёт себе каждый, кто профессионально работает с веб-архивами: как именно Wayback Machine решает, какие сайты сканировать, как часто возвращаться к ним, и почему одни домены представлены в архиве тысячами снэпшотов, а другие имеют всего несколько записей за десять лет?

Понимание этих механизмов критически важно для всех, кто занимается восстановлением сайтов. Если вы знаете, как работает система изнутри, вы можете предсказать, что найдёте в архиве, а чего там не будет. И можете повлиять на архивирование собственных сайтов, пока они ещё живы.

Читать дальше…

Понимание этих механизмов критически важно для всех, кто занимается восстановлением сайтов. Если вы знаете, как работает система изнутри, вы можете предсказать, что найдёте в архиве, а чего там не будет. И можете повлиять на архивирование собственных сайтов, пока они ещё живы.

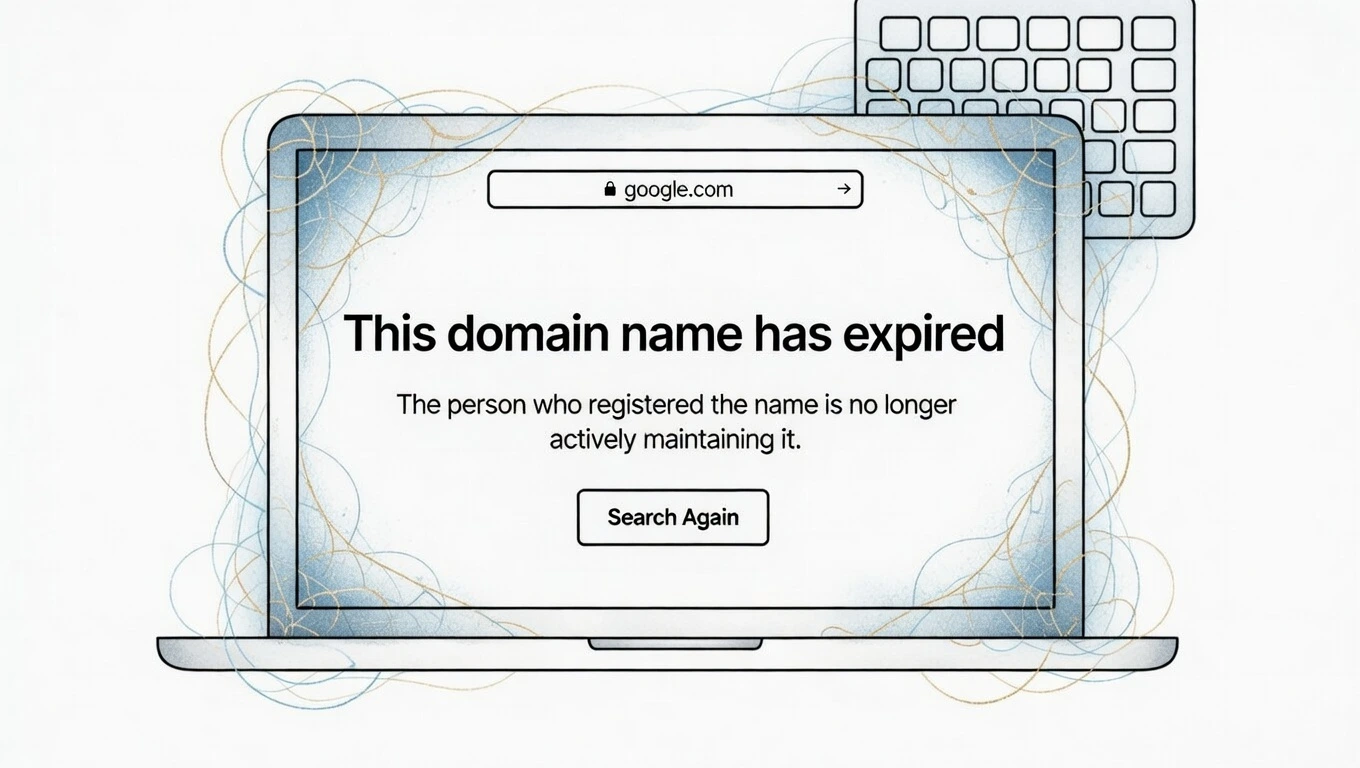

Как найти и купить истёкший домен с хорошей историей

Покупка истёкшего домена с историей это один из самых эффективных способов запустить новый проект с уже существующим ссылочным профилем, трастом и даже трафиком. Вместо того чтобы продвигать голый домен с нуля, вы получаете площадку, которую поисковые системы уже знают и которой в какой-то степени доверяют.

Читать дальше…